Hermes Agent com Ollama: Guia de Agentes Locais

Hermes Agent + Ollama é o próximo nível de agentes autônomos locais

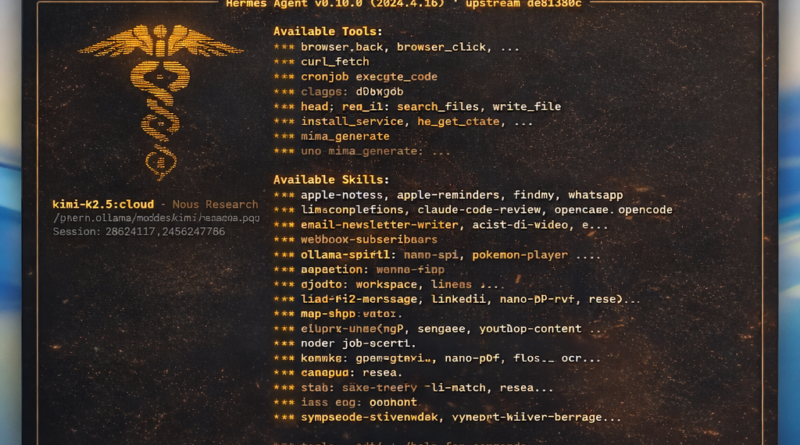

O ecossistema de agentes autônomos deu mais um salto relevante. O Hermes Agent, desenvolvido pela Nous Research, agora possui integração direta com o Ollama, simplificando drasticamente a criação de agentes inteligentes e tudo isso rodando localmente.

Se antes montar um agente envolvia múltiplas camadas de configuração (LLMs, APIs, memória, ferramentas), agora o fluxo está praticamente “plug and play”.

O que é o Hermes Agent?

O Hermes é um agente de IA com foco em autonomia e evolução contínua. Entre os principais recursos estão:

- Criação automática de skills (auto-aprendizado)

- Memória persistente entre sessões

- Mais de 70 habilidades nativas

- Arquitetura orientada a agentes (agentic workflows)

Na prática, ele não só executa tarefas, más também ele melhora com o uso.

Integração Hermes Agent + Ollama

Com a integração com o Ollama, ele visa resolver três gargalos clássicos: infraestrutura, execução local e onboarding simplificado.

Você só precisa usar um único comando:

ollama launch hermes

hermes gateway setupRodando o comando acima, será gerado um endpoint, apontando para http://127.0.0.1:11434/v1.

Modelos recomendados

Segundo a documenteação do ollama, ele sugere utilizar os modelos abaixo, para uma melhor experiência:

| Modelo | Tipo | VRAM |

|---|---|---|

| gemma4 | Local | ~16GB |

| qwen3.6 | Local | ~24GB |

| kimi-k2.5 | Cloud | — |

| glm-5.1 | Cloud | — |

Integração com canais

Você também pode configurar o gateway e com isso você consegue conectar com: Telegram, Discord, Slack, WhatsApp e Email. Desta forma seu agente vira um assistente distribuído.

Casos de uso reais

Abaixo você pode verificar, casos de usos reais do Hermes Agent + Ollama

- Automação de workflows internos

- Assistentes de desenvolvimento (Dev Agents)

- Bots inteligentes com memória real

- Orquestração de múltiplos agentes

Observação

Requisito Windows: para rodar é necessário WSL2 , instale com o comando

wsl --install

Conclusão

A integração Hermes + Ollama marca uma transição clara: de LLMs isolados para agentes autônomos operacionais.

Se você trabalha com IA aplicada, automação ou engenharia de software ou para resolver coisas pessoais, isso já não é mais experimental. É uma ferramenta de produção que irá te auxiliar nas tarefas do dia.

Referências: